Ambedded Ceph Cluster

Ambedded Ceph im Überblick

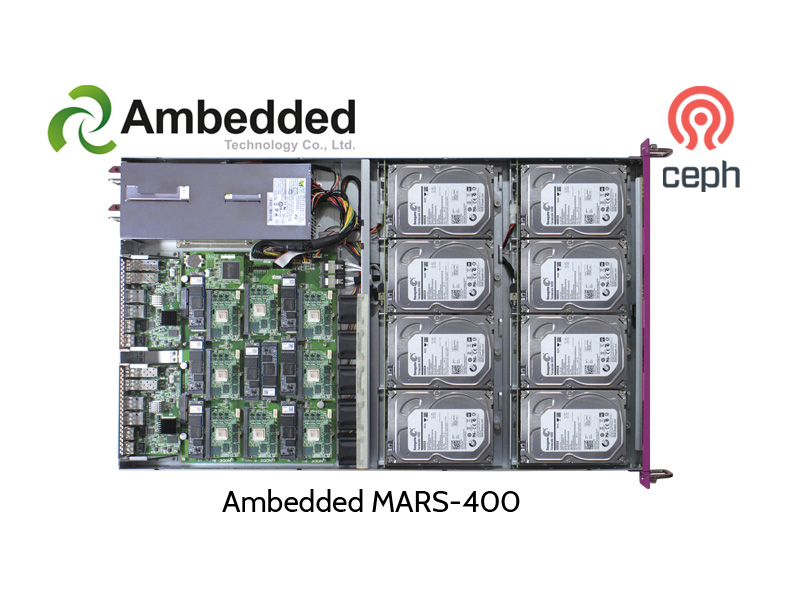

- 8 Micro-Knoten auf mit SATA Disk auf 1 HE (Mars 400)

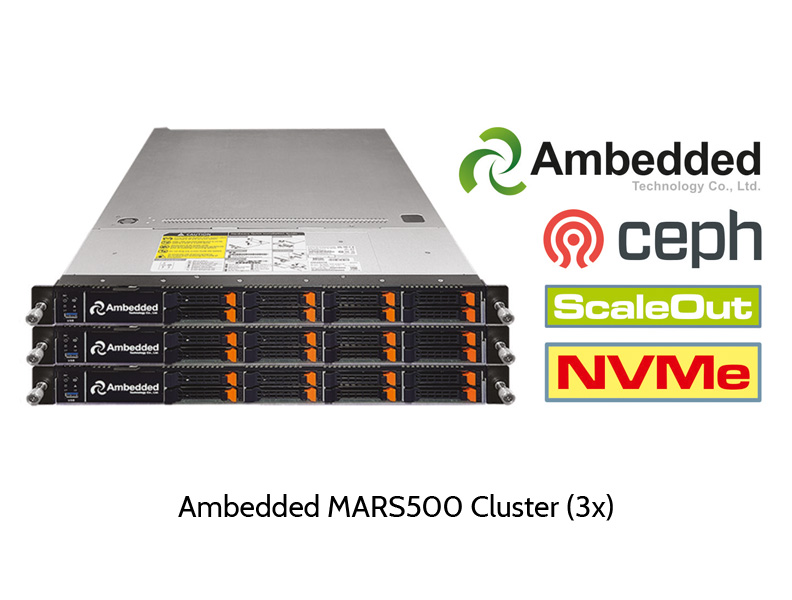

- auch: 8 oder 24 NVMe Disks in einem 2 HE Knoten (Mars 500/524)

- Scale-Out - Erweiterung on-the-fly

- dedizierte Software Management Ports pro Server

- zentrales Management des gesamten Clusters

- LED Statusanzeigen für jeden Knoten

- Ceph Software vorinstalliert auf allen Knoten (Linux: CentOS)

- Knoten einzeln konfigurierbar als Storage- oder Monitorknoten

- Object Storage Support für OpenStack Swift, Cinder und Glance

- Amazon S3 API

- Block Storage: iSCSI Block Devices

- 3 Jahre Hardware Garantie und Software Service, optional Express-Austausch-Service und Installation

Ambedded Ceph - für Sie konfiguriert

Sie haben noch Fragen zur Konfiguration?

Dann rufen Sie uns an:

+49 (0) 711 - 70 70 91 70

Produktinformation

Ceph Cluster werden normalerweise auf einzelne Server installiert. Um dann ein sinnvolles Erasure Coding bei gleichzeitig hoher Performance zu implementieren, braucht man von Anfang an viele Server – und das lohnt sich erst bei großer Daten-Kapazität.

Ambedded hat dafür eine sinnvolle Alternative entwickelt: in einem 1 HE hohen Servergehäuse befinden sich acht unabhängige Knoten, jeder mit eigenem Prozessor, einer Festplatte und einem M.2 Speicher für den Cache.

Jeder einzelne Knoten lässt sich wahlweise als Storage- oder als Monitor-Knoten konfigurieren – über eine zentrale Management Software.

So lässt sich beispielsweise mit nur drei Servern ein Cluster aufbauen, in denen je ein Monitor Knoten definiert ist (drei Stück sind ausreichend für ein echtes Quorum) und je sieben Storageknoten – beispielsweise für 2+1 Erasure Coding.Dann reichen zwei laufende Server aus, um die volle Verfügbarkeit der Daten zu gewährleisten.

Mars 500 NVMe ist die hochperformante U.3 NVMe Weiterentwicklung des Vorgängers Mars400 für 8 oder 24 NVMe SSDs. Beide Modelle können kombiniert und in bestehende Umgebungen integriert werden, was die Flexibilität aber auch die Performance Ihres CEPH Clusters enorm erhöht. Beispielsweise sind so Kombinationen aus Mars400 mit HDDs und Mars500 Knoten möglich. Der CEPH NVMe Pool kann sogar als Cache Tier vor bestehende HDDs Pools integriert werden.

Zubehörprodukte zu diesen Systemen:

Modellübersicht

| Modell | Mars 400 8 Knoten Server | Mars 500 Server mit 8 NVMe SSD | Mars 524 Server mit 24 NVMe SSD |

| pdf-Angebot | pdf-Angebot | pdf-Angebot | |

| rackmount, size | 1 HE | 2 HE | 2 HE |

| Disks | 8 pro Knoten | 24 pro Knoten | |

| Micro-Server pro System | 8 x ARM 64-bit Cortex-A72 Dual Core 1.2GHz | 1 x Ampere® Altra® 32 Core Arm 64-bit v8.2 @ 1.7 GHz, optional 64 Core @ 3.0 GHz | 1x Ampere® Altra® 64 Core Arm 64-bit v8.2 @ 3.0 GHz |

| weitere Details | s. Datenblatt | ||

| Garantie / Service | 3 Jahre Garantie + Software Update Service, optional Express-Austausch und Installation oder Vor-Ort-Service | ||